HBM 반도체, 한 줄로 먼저 답하면

HBM(High Bandwidth Memory)은 DRAM 칩을 수직으로 쌓아 데이터 전송 속도를 초당 수 테라바이트 수준으로 끌어올린 초고대역폭 메모리입니다. AI 가속기·GPU와 메모리 사이의 데이터 병목을 해소해 동일 클럭에서 처리 가능한 연산량을 2~3배로 늘려주죠. ChatGPT 같은 초거대 언어 모델이 실시간으로 작동할 수 있는 배경에는 바로 이 HBM 기술이 있습니다.

이 글에서 다룰 내용: ① HBM의 구조와 핵심 원리 ② AI 성능을 3배 높이는 기술적 이유 ③ HBM 세대별 스펙 비교와 시장 현황

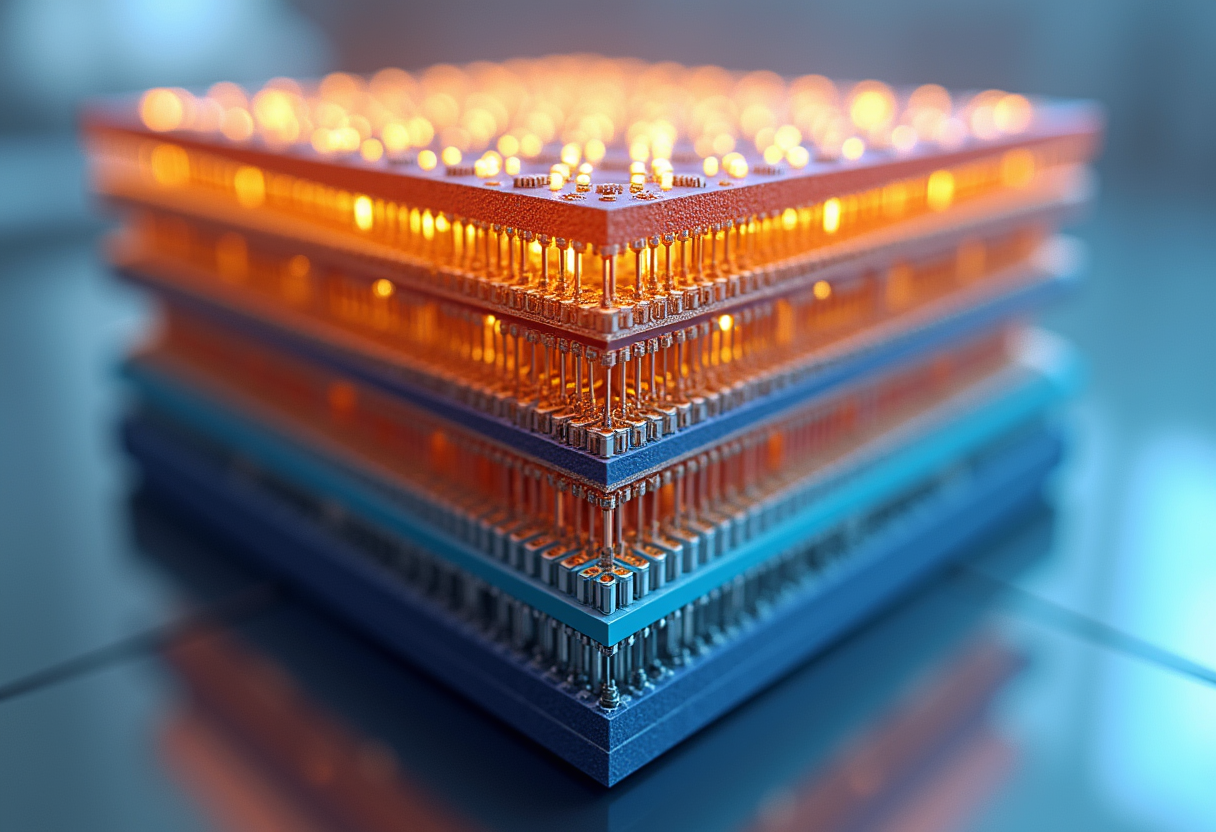

HBM 반도체의 구조: 왜 ‘수직으로 쌓는가’

HBM의 핵심은 여러 장의 DRAM 다이(Die)를 마치 팬케이크처럼 위로 겹쳐 쌓는 3D 스택 구조에 있습니다. 기존 GDDR 메모리는 칩들이 평면으로 나란히 놓여 있어 데이터가 이동하는 거리가 길고 배선 폭도 좁습니다. 반면 HBM은 수직 적층으로 데이터 이동 거리를 수십 마이크로미터(㎛) 수준으로 단축합니다.

TSV·CoW·TCB, 세 가지 패키징 기술

이 구조를 물리적으로 가능하게 만드는 기술이 세 가지입니다.

– TSV(Through-Silicon Via): 실리콘 웨이퍼를 수직으로 관통하는 초미세 구멍을 뚫어 각 층의 DRAM 다이를 전기적으로 직결합니다. 이 덕분에 칩 하나당 수천 비트(1,024비트~4,096비트)의 광폭 버스를 확보할 수 있습니다. – CoW(Chip-on-Wafer): 적층된 칩 스택을 GPU 기판 위에 직접 본딩하는 공정으로, 칩 간 거리를 최소화합니다. – TCB(Thermal Compression Bonding): 열과 압력을 동시에 가해 범프(bump) 접합을 완성하는 고정밀 공정입니다.

이 세 기술의 조합으로 HBM은 기존 GDDR6X(약 1,008GB/s) 대비 2배 이상인 초당 테라바이트급 대역폭을 실현합니다.

AI 칩 성능을 3배 높이는 원리: 병목 해소가 전부입니다

GPU나 AI 가속기는 초당 수천 조 번의 연산을 수행할 능력을 갖추고 있지만, 처리할 데이터를 메모리에서 충분히 빠르게 공급받지 못하면 연산 코어가 쉬게 됩니다. 이 현상을 ‘메모리 벽(Memory Wall)’이라고 부르며, 기존 DRAM 기반 시스템에서 AI 학습 속도를 가로막는 가장 큰 구조적 한계였습니다.

HBM이 메모리 벽을 무너뜨리는 방식

HBM은 세 가지 방식으로 이 병목을 동시에 공략합니다.

① 대역폭 폭발적 확대: HBM3E 기준 한 스택당 최대 1.2TB/s의 전송 속도를 제공합니다. NVIDIA H100 GPU에 탑재된 HBM3는 스택 5개를 묶어 총 3.35TB/s를 구현했고, 이는 DDR5 대비 약 15배 높은 수치입니다.

② 전력 효율 30~50% 향상: 데이터 이동 거리가 수십 ㎛로 줄어들면서 신호 전송에 필요한 전력이 크게 감소합니다. 삼성반도체 자료에 따르면 HBM은 동급 성능의 GDDR 대비 전력 소모를 최대 50% 낮춥니다.

③ AI 추론·학습 속도 약 3배 가속: 메모리 대기 시간(Latency)이 줄고 데이터 공급이 연속적으로 이뤄지면서 동일 클럭 대비 처리 연산량이 2~3배 증가합니다. 실제로 NVIDIA A100(HBM2e, 2TB/s) 대비 H100(HBM3, 3.35TB/s)의 AI 학습 처리량은 약 3배 향상된 것으로 보고됩니다.

HBM 세대별 진화와 시장 현황

HBM은 2013년 AMD와 SK하이닉스가 공동 개발한 1세대(HBM1, 128GB/s)를 시작으로 빠르게 진화해왔습니다. 2025년 현재 HBM3E가 주력 양산 제품이고, HBM4는 2025년 하반기 본격 출하를 앞두고 있습니다.

HBM 공급 경쟁: SK하이닉스·삼성·마이크론

시장조사기관 트렌드포스(TrendForce)에 따르면 2024년 기준 HBM 시장 점유율은 SK하이닉스가 약 53%, 삼성전자가 약 35%, 마이크론이 약 12%를 차지하고 있습니다. SK하이닉스는 NVIDIA H100·H200에 HBM3·HBM3E를 독점 공급하며 시장을 선도 중입니다. HBM 시장 규모는 2023년 약 40억 달러에서 2025년 200억 달러를 넘어설 것으로 전망됩니다.

| 세대 | 출시 연도 | 스택당 대역폭 | 주요 탑재 제품 |

|---|---|---|---|

| HBM1 | 2013 | 128 GB/s | AMD Fiji GPU |

| HBM2 | 2016 | 256 GB/s | NVIDIA V100 |

| HBM2E | 2020 | 460 GB/s | NVIDIA A100 |

| HBM3 | 2022 | 819 GB/s | NVIDIA H100 |

| HBM3E | 2024 | 1,200 GB/s | NVIDIA H200 |

| HBM4 | 2025(예정) | 1,500 GB/s+ | 차세대 AI 가속기 |

HBM vs GDDR: 어떤 상황에서 무엇을 쓰나요?

| 항목 | HBM | GDDR6X |

|---|---|---|

| 대역폭 | 최대 1.2 TB/s | 최대 1.0 TB/s |

| 전력 효율 | 우수 (50% 낮음) | 상대적으로 낮음 |

| 단가 | 매우 고가 | 저렴 |

| 주요 용도 | AI 가속기, HPC | 게임 GPU, 그래픽 |

| 폼팩터 | 기판 위 직접 본딩 | 독립 모듈 |

자주 묻는 질문

HBM과 일반 DDR5 메모리의 차이는 무엇인가요?

HBM은 DRAM을 수직 적층해 최대 1.2TB/s의 대역폭을 제공하는 반면 DDR5는 단일 모듈 구조로 최대 약 80GB/s 수준에 머뭅니다. 속도 차이만 약 15배에 달하며 AI 추론·학습처럼 대량의 데이터를 연속 처리하는 작업에서 HBM의 우위가 압도적입니다.

HBM은 일반 소비자용 PC에 탑재될 수 있나요?

현재 HBM은 단가가 GDDR6X 대비 5~10배 이상 높아 AI 서버·HPC 전용으로 사용됩니다. 다만 AMD가 라데온 RX 시리즈 일부에 HBM을 탑재한 사례가 있어, 향후 제조 공정이 최적화되면 고성능 소비자 GPU로 확산될 가능성도 있습니다.

핵심 세 가지로 정리합니다

1. HBM 반도체란 DRAM을 3D로 적층하고 TSV로 연결해 초당 테라바이트급 데이터를 전송하는 초고대역폭 메모리입니다. 2. AI 성능을 3배 높이는 이유는 메모리 벽을 해소해 GPU 연산 코어에 데이터를 끊김 없이 공급하고 전력 효율을 30~50% 개선하기 때문입니다. 3. 시장은 빠르게 성장 중이며 2025년 200억 달러 규모를 돌파할 전망으로, SK하이닉스·삼성·마이크론 3사가 HBM4 경쟁에 돌입해 있습니다.

HBM의 다음 단계인 HBM4가 어떻게 AI 인프라를 바꿀지, 그리고 국내 반도체 기업들의 점유율 경쟁이 어떻게 전개될지 지속적으로 주목할 만한 이유가 여기에 있습니다.

#HBM반도체 #AI칩성능 #고대역폭메모리 #TSV기술 #SK하이닉스HBM